Tecnología

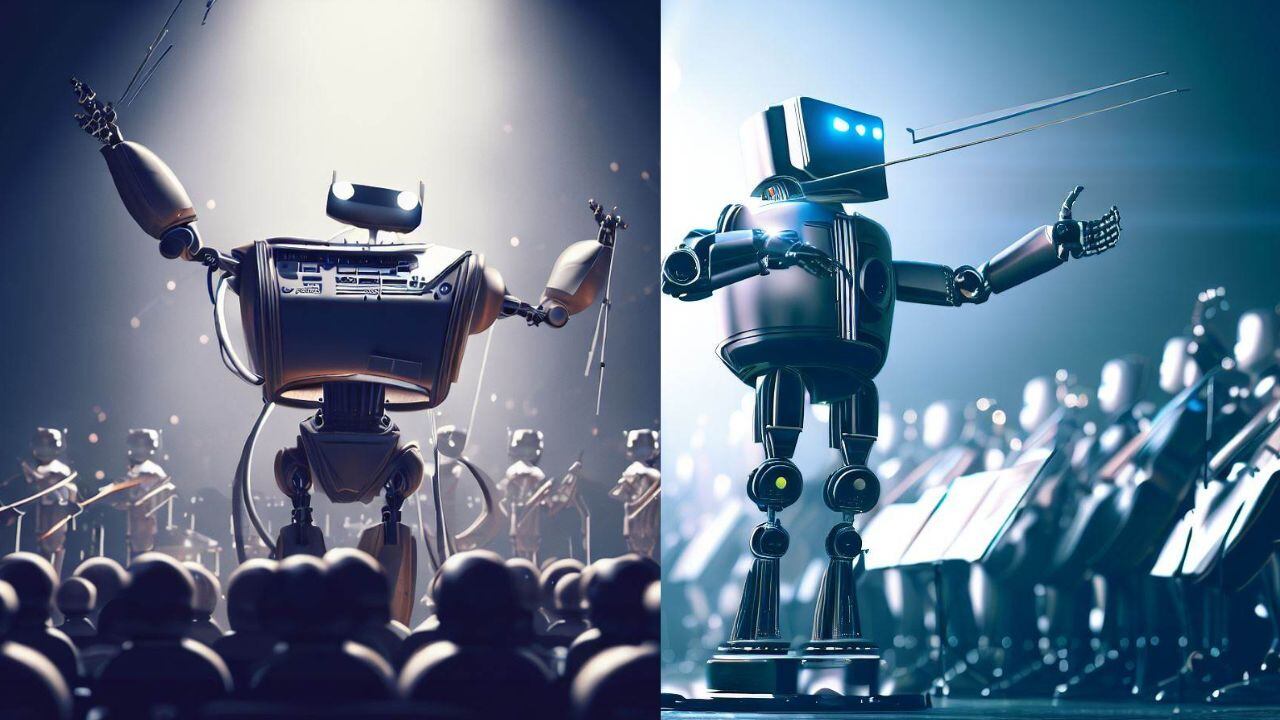

‘EveR 6′: el robot director de orquesta que llevó la batuta en un concierto

El robot fue capaz de guiar a los intérpretes tanto de forma independiente como en colaboración con un director humano a su lado durante cerca de media hora.

Un robot de fabricación surcoreana hizo su debut como director de orquesta en Seúl el viernes, encandilando a la audiencia con una actuación impecable.

‘EveR 6′, un androide de 1,8 metros de altura, dirigió a más de 60 músicos de la Orquesta Nacional de Corea del Sur que tocaban distintos instrumentos tradicionales.

‘EveR 6′ fue capaz de guiar a los intérpretes tanto de forma independiente como en colaboración con un director humano a su lado durante cerca de media hora, causando la admiración de los más de 950 asistentes al concierto, organizado en el Teatro Nacional de Corea.

El robot fue ampliamente ovacionado al aparecer en escena, cuando saludó al público con una reverencia. Durante la actuación, sus ojos azules se centraban en los músicos, tan solo a asintiendo con la cabeza al ritmo de la melodía.

Lo más leído

El novato ofreció una buena actuación, aseguró parte de los asistentes. “Vine aquí preocupada por si el robot podría hacerlo”, dijo a la AFP Kim Ji-min, estudiante universitaria de 19 años, que se está especializando en música.

“Pero descubrí que estaba en gran armonía con los músicos... Se sentía como un mundo completamente nuevo para mí”, indicó.

Si bien ha habido actuaciones musicales a cargo de directores robóticos en el pasado, incluido un concierto de 2017 dirigido por el robot YuMi en Italia, esta fue la primera vez que los surcoreanos pudieron ver a uno en el escenario.

‘EveR 6′, desarrollado por la empresa estatal Korea Institute of Industrial Technology, fue programado para replicar los movimientos de un humano mediante tecnología de captura de la moción.

Por el momento, sin embargo, no es capaz de escuchar o improvisar en tiempo real. Sus desarrolladores están trabajando actualmente para permitir que el robot haga gestos que no estén preprogramados, explicó Lee Dong-wook, el ingeniero del robot.

En imágenes: robot ‘chef’ aprende a hacer recetas viendo videos en redes

Investigadores de Cambridge entrenaron a un ‘chef’ robot para ver y aprender por medio de videos de cocina y así poder recrear un plato en sí, a partir de ocho sencillas recetas de ensalada.

Después de ver un video de un humano demostrando una de las recetas, el robot pudo identificar qué receta se estaba preparando y hacerla. Además, los videos ayudaron al robot a agregar gradualmente a su libro de cocina. Al final del experimento, el robot ideó una novena receta por su cuenta.

Sus resultados, publicados en la revista IEEE Access, demuestran cómo el contenido de video puede ser una fuente valiosa y rica de datos para la producción automatizada de alimentos y podría permitir una implementación más fácil y económica de chefs robot.

Los chefs robóticos han aparecido en la ciencia ficción durante décadas, pero en realidad, cocinar es un problema desafiante para un robot. Varias empresas comerciales han construido prototipos de chefs robóticos, aunque ninguno de ellos está actualmente disponible comercialmente, y están muy por detrás de sus contrapartes humanas en términos de habilidad.

Los cocineros humanos pueden aprender nuevas recetas a través de la observación, ya sea viendo a otra persona cocinar o viendo un video en YouTube, pero programar un robot para hacer una variedad de platos es costoso y requiere mucho tiempo.

“Queríamos ver si podíamos entrenar a un robot chef para que aprendiera de la misma manera progresiva que los humanos, identificando los ingredientes y cómo se combinan en el plato”, dijo en un comunicado Grzegorz Sochacki del Departamento de Ingeniería de Cambridge, el primer autor del artículo.

Sochacki, candidato a doctorado en el laboratorio de robótica bioinspirada del profesor Fumiya Iida, y sus colegas idearon ocho sencillas recetas de ensaladas y se filmaron haciéndolas. Luego usaron una red neuronal disponible públicamente para entrenar a su robot chef. La red neuronal ya había sido programada para identificar una variedad de objetos diferentes, incluidas las frutas y verduras utilizadas en las ocho recetas de ensaladas (brócoli, zanahoria, manzana, plátano y naranja).

Usando técnicas de visión por computadora, el robot analizó cada cuadro de video y pudo identificar los diferentes objetos y características, como un cuchillo y los ingredientes, así como los brazos, las manos y la cara del demostrador humano. Tanto las recetas como los videos se convirtieron en vectores y el robot realizó operaciones matemáticas en los vectores para determinar la similitud entre una demostración y un vector.

Al identificar correctamente los ingredientes y las acciones del chef humano, el robot podía determinar cuál de las recetas se estaba preparando. El robot podría inferir que si el demostrador humano sostenía un cuchillo en una mano y una zanahoria en la otra, la zanahoria sería cortada en pedazos.

De los 16 videos que vio, el robot reconoció la receta correcta el 93 % de las veces, aunque solo detectó el 83 % de las acciones del chef humano. El robot también pudo detectar que ligeras variaciones en una receta, como hacer una porción doble o un error humano normal, eran variaciones y no una nueva receta. El robot también reconoció correctamente la demostración de una novena ensalada nueva, la agregó a su libro de cocina y la preparó.

Con información de AFP.