Opinión

Cárceles al límite: hacinamiento, crimen y una salida algorítmica

Imaginemos por un momento que estamos en una prisión de máxima seguridad.

Colombia enfrenta una crisis penitenciaria que ha superado cualquier medida de control tradicional. De acuerdo con el boletín estadístico del Inpec de 2023, existe un hacinamiento que alcanza el 24.3 % en las cárceles del país y una población privada de libertad que ya supera las 101,622 personas. El sistema carcelario no solo se encuentra desbordado, sino que se ha convertido en un epicentro de criminalidad. El hurto, tráfico de estupefacientes y homicidio figuran entre los principales delitos cometidos por reclusos dentro de los propios establecimientos penitenciarios, evidenciando que las prisiones no han logrado frenar la delincuencia, sino que, en muchos casos, han servido como centros de operaciones del crimen organizado. Más alarmante aún, la reincidencia penitenciaria alcanza un 23.8 %, lo que significa que casi una de cada cuatro personas que ha cumplido una condena vuelve a delinquir. En este panorama desolador de décadas, donde el Estado invierte más de 2.7 billones de pesos anuales en mantener un sistema que no resocializa ni contiene el delito, surge una pregunta clave: ¿puede la tecnología, y en particular la inteligencia artificial, ofrecer una solución real? Frente a una crisis de esta magnitud, la automatización de la vigilancia, el monitoreo predictivo y los sistemas de reinserción asistidos por algoritmos podrían marcar la diferencia entre un modelo penitenciario obsoleto y uno que, finalmente, funcione.

Imaginemos por un momento que estamos en una prisión de máxima seguridad. Cámaras con visión artificial analizan cada movimiento, sensores de sonido detectan palabras clave en conversaciones de reclusos, guardianes y sistemas predictivos identifican quién tiene más probabilidades de reincidir. No, no es una serie de ciencia ficción, es el presente. La inteligencia artificial (IA) ha irrumpido con fuerza en el mundo penitenciario, vendida como la solución definitiva a la criminalidad y la ineficiencia carcelaria. Pero, ¿es realmente un milagro digital o simplemente el experimento de control social más ambicioso que hemos visto?

En El Salvador, la vigilancia y análisis de datos en las cárceles hace tiempo se apoya con IA. Incluso, el programa ‘Cero Ocio’, que involucra a 21,000 presos en fase de confianza que no son pandilleros, que trabajan y se capacitan, se gestiona y evalúa con algoritmos inteligentes. Los resultados son impresionantes, las cifras, por ejemplo, de reincidencia son de un solo dígito, Aquí no hay margen de error ni compasión algorítmica: el que no cumple, no avanza. No hay espacio para pretextos ni para la nostalgia del viejo sistema penitenciario lleno de listas en papel y custodios contando cabezas.

Pero antes de aplaudir o condenar esta revolución tecnológica, veamos cómo funciona la IA en las prisiones alrededor del mundo.

Lo más leído

La IA como el nuevo “alcaide”

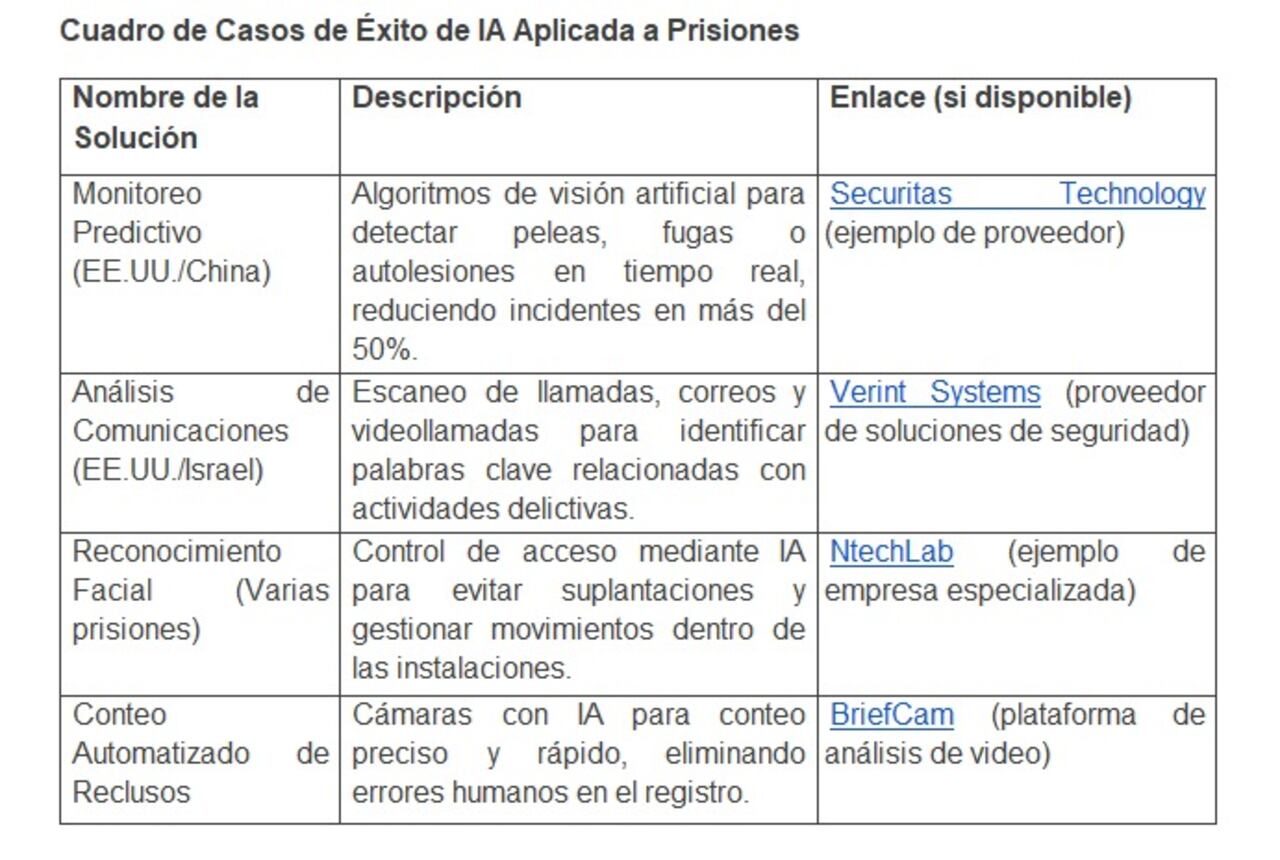

Las aplicaciones de IA en prisiones han evolucionado de simples cámaras de seguridad a sistemas que, prácticamente, sustituyen a los guardias. En la práctica, encontramos:

1. Seguridad y control absoluto

- Monitoreo de comportamiento: algoritmos analizan imágenes en tiempo real para detectar peleas, intentos de fuga o autolesiones. La IA ha reducido en más del 50 % los incidentes en prisiones de EE. UU. y China.

- Análisis de comunicaciones: conversaciones telefónicas, videollamadas y correos electrónicos son escaneados en busca de palabras clave que indiquen amenazas o delitos en curso. Esta tecnología funciona en varias prisiones de EE. UU. e Israel.

- Reconocimiento facial y control de acceso: se acabaron los pases falsos; solo los algoritmos deciden quién entra y quién sale.

2. Gestión operativa con precisión quirúrgica

- Conteo de reclusos automatizado: nada de pasar lista como en la escuela. Cámaras con IA detectan en segundos quién falta y quién está, donde no debería.

- Mapas de calor: controlan la densidad de reclusos en áreas críticas para prevenir motines.

- Optimización de recursos: desde la distribución de comida hasta la asignación de celdas, todo se decide con modelos predictivos.

3. Rehabilitación (o al menos su intento)

- Evaluación de riesgos de reincidencia: algoritmos analizan historiales y comportamiento para personalizar programas de reinserción.

- Educación con IA: plataformas de aprendizaje adaptadas a cada recluso, sin necesidad de tutores humanos.

¿Milagro digital o distopía penitenciaria?

Ahora bien, no todo es eficiencia sin fisuras. La IA también nos trae desafíos monumentales:

¿Quién audita al algoritmo?

Si un sistema decide que un preso es peligroso y debe permanecer aislado, ¿quién garantiza que el algoritmo no está sesgado? Casos en EE. UU. han demostrado que los modelos predictivos de reincidencia pueden discriminar según raza y antecedentes socioeconómicos.

Privacidad, esa cosa incómoda

Analizar conversaciones de presos con guardias, entre privados de libertad y sus familias, afecta evidentemente su privacidad. Sin embargo, hoy hay desarrollos impresionantes que monitorean de forma anónima todas las conversaciones, pero solo disparan alarmas cuando hay lenguaje verbal o no verbal que salga de la normalidad o sea claramente delictivo.

Errores al interpretar

Investigadores de Stanford descubrieron que los sistemas de reconocimiento de voz basados en IA cometen el doble de errores al interpretar el inglés afroamericano que al interpretar el inglés de personas blancas. Esto puede llevar a una vigilancia desproporcionada y a la discriminación de reclusos que hablan este dialecto.

Errores en la evaluación de riesgos

Un informe del American Correctional Association describe un caso en el que un sistema de IA interpretó erróneamente una publicación en redes sociales sobre una “fiesta”, que en realidad era el cumpleaños del hijo de un recluso. Resultado: lo clasificaron como de alto riesgo sin motivo.

La realidad es que la IA ha llegado para quedarse en el mundo penitenciario. No es perfecta, pero tampoco podemos regresar a un sistema donde todo se manejaba con papeleo y la única seguridad era la intuición de los guardias. La pregunta no es si la IA debe usarse en prisiones, sino cómo garantizamos que su implementación, su entrenamiento, su transparencia esté acompañada de profesionalismo y equidad por ejemplo siguieron la ayuda de psicólogos expertos en IA calificados para lograr entrenar el sistema en analizar y acompañar procesos de reinserción real.

Y aquí es donde la ironía nos golpea en la cara: en un sistema donde los humanos fracasaron, hemos decidido confiarle la seguridad y rehabilitación de los presos… a un algoritmo. Lo único seguro es que si Skynet alguna vez toma el control, ya sabe dónde encontrarnos.

Experto en Seguridad Ciudadana, Comisionado Presidencial de DD. HH. y Libertad de Expresión de El Salvador, este es un artículo académico, no refleja ninguna postura oficial del gobierno de El Salvador.